Meir KI i høgt tempo

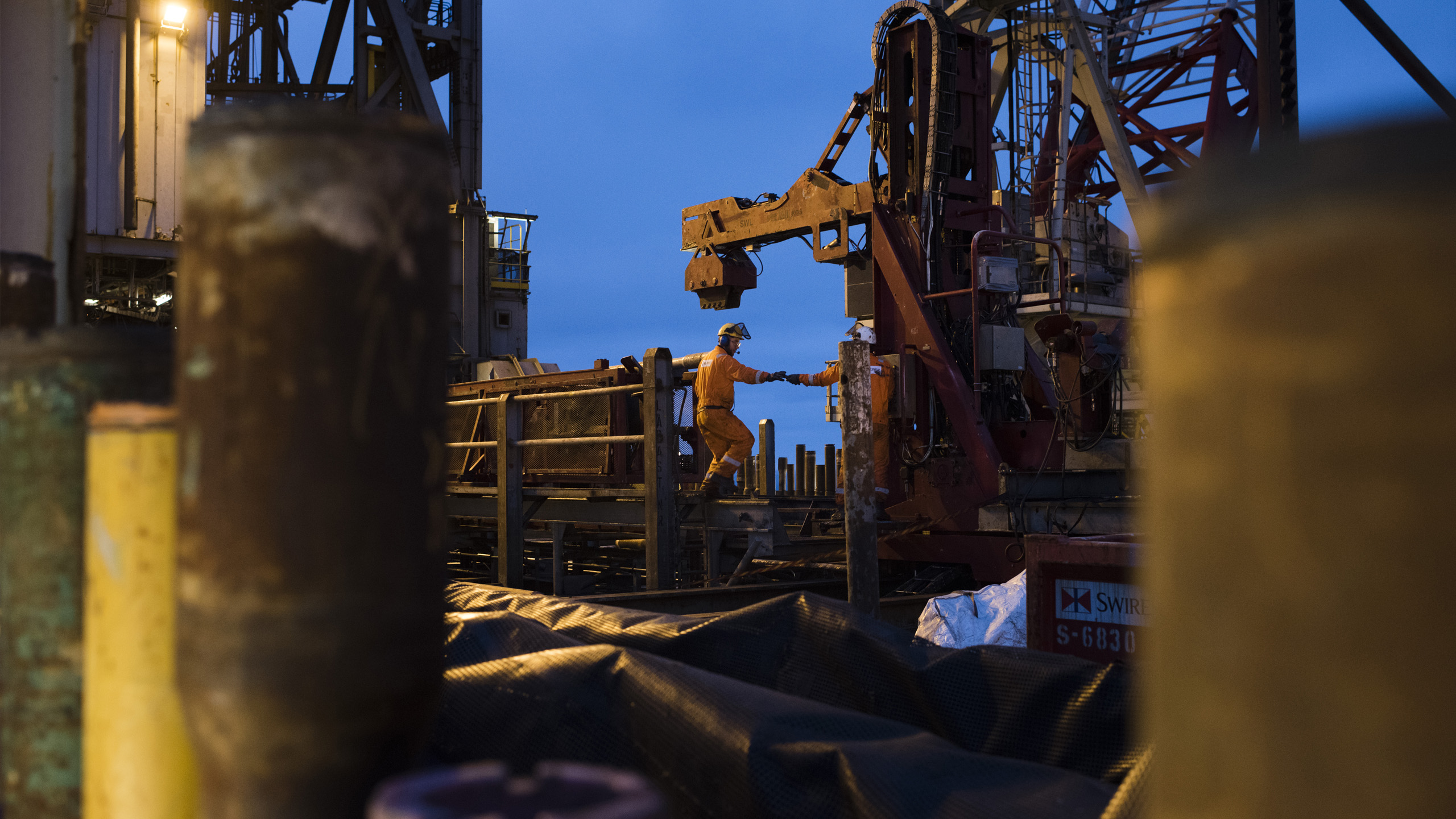

Foto: Elisabeth Kjørmo

Foto: Elisabeth Kjørmo

Formålet med studien, som er gjennomført av DNV på oppdrag frå Havtil, har vore å auka kunnskapen om risiko ved utvikling og bruk av KI i operasjonar som har samband med tryggleiken på norsk sokkel. Målet har vidare vore å utforska korleis KI kan forbetra effektivitet og tryggleik, samtidig som ein tek omsyn til dei unike risikoane KI introduserer samanlikna med tradisjonelle IT- og automatiseringssystem.

Kvar kjem KI?

Kunnskapsoversikta viser tydeleg forventning til at KI vil bli innført i petroleumsverksemda i høgt tempo. I første omgang vil KI bli nytta for å generera ulike typar dokument og kjeldekode og vil på kort sikt bli brukt i ulike typar rådgivande applikasjonar – til dømes innan driftsoptimalisering og prediktivt vedlikehald.

På lengre sikt er KI forventa brukt også i kontrollfunksjonar, mellom anna i samband med løfteoperasjonar og brønnkontroll. Autonome KI-baserte system blir i første omgang innførde der skadepotensialet er lågt, eksempelvis i undervassfarkostar og dronar.

Kva risiko er knytt til bruk av KI?

Rapporten, som vart publisert hausten 2024, identifiser ei rekkje KI-relaterte risikoar som kan føra til at operasjonar hamnar i ein utrygg tilstand. Nokre døme er:

- Utilstrekkeleg trening av algoritmar

- Dårleg datakvalitet

- Modellforringing over tid

- Overtilpassing til treningsdata

I tillegg vil også KI-baserte system vera sårbare for svakheiter i programvaredesign, feil i maskinvare og villa handlingar som cyber-angrep.

KI er forventa teke i bruk i ulike typar system og operasjonar. For dei fleste av desse er det fare for at informasjon generert ved hjelp av KI-baserte system, kan føra til at det blir teke feil operasjonelle avgjerder, noko som igjen kan føra til ulykker.

Rapporten bruker omgrepet «sikkerheitsrelaterte system» som eit samleomgrep for sikkerheitssystem, kontroll- og overvakingssystem – i tillegg til system for rådgiving, planlegging, og tilstandsovervaking.

Bruk av barrierar

Det er venta at sikkerheit for menneske og miljø også i framtida vert ivareteken gjennom barrierefilosofi, som ligg til grunn for Havtil sitt regelverk.

Tankegangen bak barrierefilosofien er at same kor godt ein prøver å få til ei sikker og robust løysing, vil feil, fare- og ulykkessituasjonar kunne henda. Då skal barrierar tre i kraft og bidra til å handtera situasjonane.

Dersom ein KI-basert applikasjon skulle gi resultat som gjer at ein operasjon hamnar i utrygg tilstand, er filosofien at barrierar skal hindra at tilstanden eskalerer til ei farleg hending.

Døme på slike barrierar er menneskeleg overstyring, bruk av uavhengige kontrollfunksjonar og bruk av uavhengige sikkerheitsfunksjonar som stengjer ned prosessen som blir kontrollert. I tillegg kjem bruk av operasjonelle restriksjonar. Desse vil redusera risikoen for ei hending dersom dei andre barrierane ikkje er effektive.

Samspelet KI og menneske

For mange typar operasjonar vil det i dag vera menneske som tek avgjerda om å aktivera barrierar. Utfordringa er at uønskte tilstandar i programvare ikkje alltid fører til alarmar. Det er til dømes ikkje gitt at ein får alarm dersom ein KI-algoritme blir utsett for eit operasjonelt scenario han ikkje er trena for.

I ein slik situasjon vil barrierar berre bli aktiverte dersom menneske er i stand til å forstå at noko er gale basert på den totale mengda tilgjengeleg informasjon. Det understrekar behovet for samspel mellom KI og menneske, behovet for eit menneskesentrert design av KI-løysingar og behovet for å kunna detektere utrygge tilstandar på ein måte som er uavhengige av systemet som inneheld KI.

Auka kapabilitet og kompleksitet

KI vil typisk auka både kapabilitet og kompleksitet for eit system. Forsking viser at di meir kapabelt og komplekst eit system blir, jo mindre evne har brukaren til å forstå systemet og dei avgrensingane det har og til å overvaka det på ein påliteleg måte.

Utfordringa knytt til menneskeleg deteksjon av utrygge tilstandar, tilseier at industrien bør utforska moglegheitene for automatisert deteksjon av utrygge tilstandar forårsaka av KI.

Les meir om studien

Les meir: Kunnskapsoversikt knyttet til forsvarlig bruk av kunstig intelligens i petroleumssektoren

Faktorar som kan avgrensa

For at barrierane alltid skal vera effektive, må det vera mogleg å detektera at ein utrygg tilstand har oppstått, same kva som har forårsaka han. Dersom ei programvare på ein eller annan måte har medført ein utrygg tilstand, er deteksjon, uansett årsak, berre mogleg dersom ein har tilgang på deteksjonsmekanismar som er heilt uavhengige av denne programvara.

Ein sikkerheitsfunksjon som automatisk blir aktivisert når eigne målingar av tilstanden til ein sikkerheitskritisk prosess tilseier at dette er nødvendig, er eit døme på ein barriere der slik uavhengig deteksjon er tilgjengeleg.

Auka grad av automasjon gjer likevel at det at det i mange tilfelle kan vera vanskeleg å detektera uønskte tilstandar på ein uavhengig måte same kva som har forårsaka tilstanden.

Det betyr at petroleumsindustrien bevegar seg mot ei gråsone der det, som i mange andre industriar, er kritiske og komplekse funksjonar som kontinuerleg må verka etter intensjon for at sikkerheita skal vera ivareteken.

Utfordringane her er særleg knytt til menneskeleg deteksjon av uønskte tilstandar. Desse utfordringane vil ofte vera til stade uavhengig av om KI blir nytta eller ikkje, men bruk av KI kan forsterka problemet.

Mangel på mekanismar som kan detektera utrygge tilstandar, uavhengig av systemet som nyttar KI, er forventa å vera ein avgrensande faktor for kor KI kan introduserast på ein sikker måte.

Forskrifter og standardar

Standardane Havtil sitt regelverk refererer til når det gjeld reine sikkerheitsfunksjonar, stiller svært strenge krav til korleis programvare skal utviklast, verifiserast og validerast. Innføring av KI i slike funksjonar vil dermed utløysa ei stor bevisbyrde. DNV meiner derfor at introduksjon av KI i slike funksjonar ikkje kan forventast i nær framtid.

Ein ser likevel ikkje vekk frå at KI-baserte komponentar kan bli innførde på lengre sikt. Til dømes i form av KI-basert aktivering av sikkerheitsfunksjonar som tillegg til menneskeleg aktivering.

For nokre KI-system vil resultata som blir produserte, ikkje vera deterministiske. Det betyr at det fleire testar med same inngangsdata, ikkje nødvendigvis gir dei same resultata. Dette kan gjera kvalifisering, validering og vedlikehald av programvare som inneheld KI, vanskeleg. Det kan også vera ein avgrensande faktor for kor KI kan innførast.

Industrien bør utforska korleis denne utfordringa kan løysast.

Behov for felles rettleiingar

Havtil sitt regelverk viser til ei lang rekkje standardar og rettleiingar, både norske og internasjonale. Desse vel dei fleste aktørane å følgja, sidan ein ellers må demonstrera at alternative tilnærmingar er like bra eller betre. Bruk av felles standardar og rettleiingar bidreg til eit harmonisert sikkerheitsnivå i petroleumsindustrien.

Så langt er det ikkje utarbeidd standardar eller rettleiingar spesifikt med tanke på sikker bruk av KI innanfor petroleumsindustrien. For å halda oppe eit harmonisert sikkerheitsnivå, og for å redusera bevisbyrda for kvar enkelt aktør, vil det vera ønskjeleg at relevante aktørar i industrien går saman om å utarbeida rettleiingar som representerer beste praksis for bruk av ulike typar løysingar som inneheld KI.

Eit slikt arbeid bør gjera det enklare å møta krava i EU-forordninga om KI. Førebels må kvar enkelt aktør som ønskjer å ta i bruk KI, sjølv konkretisera og svara ut krava i forordninga i eigne styringssystem.

Slik operasjonalisering av høgnivåkrav er vanlegvis arbeidskrevjande, men arbeidsbyrda på kvar enkelt organisasjon bør kunna reduserast dersom industrien går saman om det.